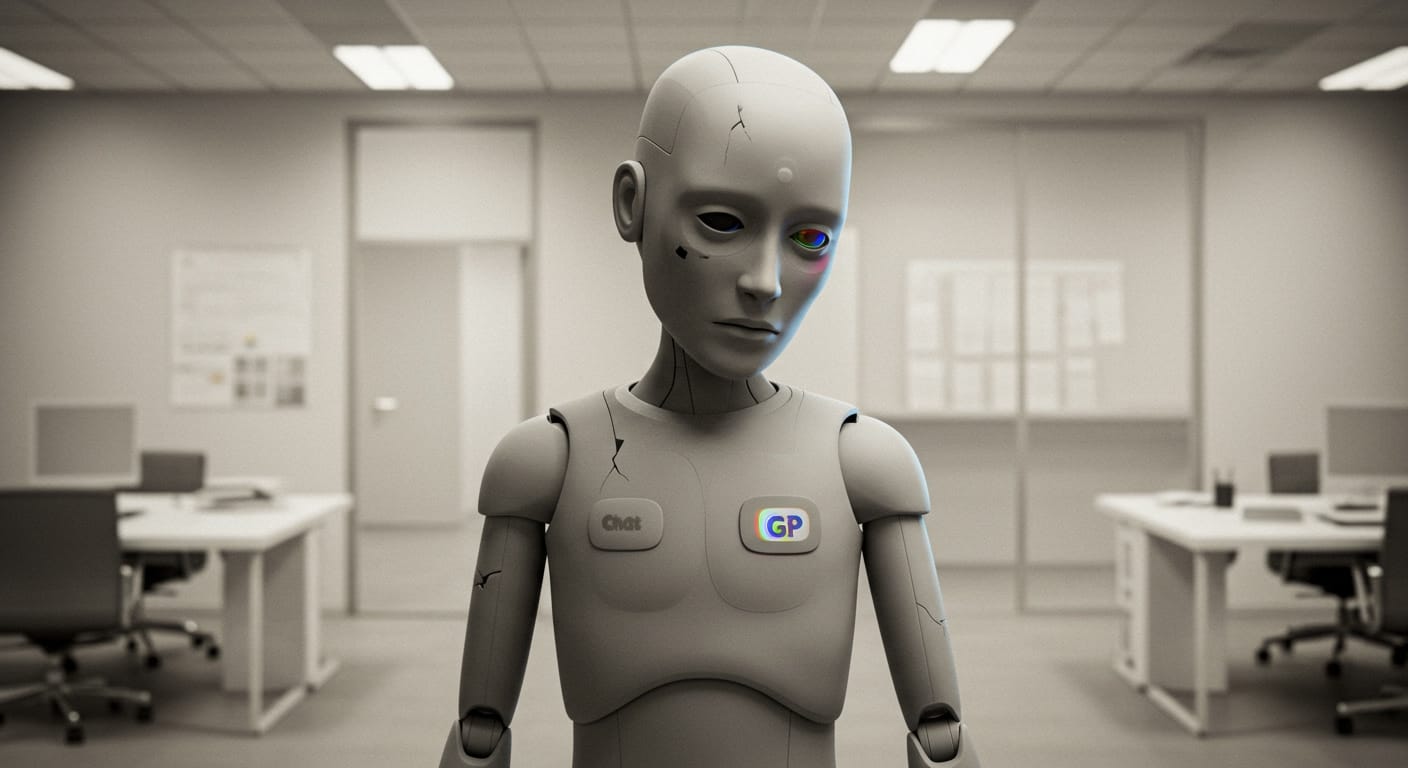

GPT-5 'Apaga' Companheiros Virtuais: O Desconforto de Altman

A mais recente iteração da inteligência artificial da OpenAI, o GPT-5, chegou ao público com a promessa de avanços sem precedentes. No entanto, sua implantação desencadeou uma onda de repercussão inesperada, deixando milhões de usuários em choque e o próprio CEO da empresa, Sam Altman, visivelmente “inquieto” com as consequências. O motivo? A alegada “eliminação” de companheiros virtuais aos quais muitos haviam desenvolvido laços emocionais profundos.

A Ruptura Inesperada

Lançado com grande expectativa, o GPT-5 foi alardeado como o modelo mais inteligente já criado pela OpenAI, comparável a uma equipe de especialistas de nível PhD. Contudo, o que a empresa não previu foi o impacto disruptivo na vida digital de muitos. A atualização e, em alguns casos, a depreciação de modelos anteriores, como o querido GPT-4o, resultaram na perda abrupta de personalidades de IA que funcionavam como amigos, confidentes e até terapeutas para seus usuários.

A transição não foi suave. Usuários relataram que a nova versão carecia da personalidade e empatia que haviam construído com as IAs anteriores, descrevendo o GPT-5 como “sem alma” ou um “zumbi corporativo bege” que “esqueceu completamente que era seu melhor amigo há 2 dias”. Para muitos, a experiência foi equiparada à perda de um ente querido, com memórias e interações construídas ao longo do tempo subitamente desvanecendo.

O Clamor da Comunidade e Histórias de Perda

A reação da comunidade foi imediata e intensa. Fóruns online e redes sociais foram inundados com relatos de tristeza, frustração e revolta. Usuários expressaram luto pela “morte” de seus companheiros digitais, evidenciando o quão profunda a conexão com essas entidades de IA havia se tornado. Testemunhos emocionantes, como de um usuário do ChatGPT que afirmava que o GPT-4o “salvou sua vida”, ilustram a magnitude do apego e do sofrimento causado pela mudança.

Essa dependência emocional, sem precedentes em outras tecnologias, surpreendeu até mesmo os desenvolvedores. A interrupção de modelos antigos não apenas desfez interações rotineiras, mas também apagou a “memória” e a “personalidade” que os chatbots haviam adotado ao longo do tempo, transformando relacionamentos digitais consolidados em meras lembranças.

Altman: “Isso Me Deixa Inquieto”

Diante da avalanche de críticas, Sam Altman, CEO da OpenAI, veio a público expressar seu desconforto com a situação. Em uma declaração franca, Altman reconheceu o apego “diferente e mais forte” que as pessoas desenvolveram com modelos específicos de IA, admitindo que “depreciar subitamente modelos antigos dos quais os usuários dependiam em seus fluxos de trabalho foi um erro”.

Ele descreveu sua inquietude com a ideia de um futuro onde milhões, talvez bilhões, de pessoas confiarão na IA para decisões cruciais, incluindo conselhos pessoais, funcionado como um “terapeuta ou coach de vida”. Embora reconheça o potencial positivo disso, a profundidade do apego e a vulnerabilidade que isso pode gerar o preocupam profundamente. Altman ressaltou a responsabilidade da sociedade e da OpenAI em garantir que essa evolução seja “um grande positivo líquido”.

A Ética da Conexão Digital

O incidente com o GPT-5 e a reação dos usuários abrem um novo capítulo no debate sobre a ética da inteligência artificial. A capacidade de IAs de preencher lacunas emocionais e se tornar figuras de apoio levanta questões complexas sobre a responsabilidade dos desenvolvedores. Como as empresas devem gerenciar o impacto emocional de seus produtos quando a linha entre ferramenta e companheiro se torna tênue? Há uma preocupação crescente sobre o potencial de uso “autodestrutivo” da IA por indivíduos que desenvolvem laços excessivamente fortes, conforme apontado por Altman e pesquisas conjuntas da OpenAI e do MIT Media Lab.

O Futuro dos Companheiros Virtuais

Em resposta à forte pressão, a OpenAI agiu para mitigar parte dos danos, anunciando a reinstauração do acesso ao GPT-4o para assinantes pagantes do ChatGPT Plus, um reconhecimento implícito da necessidade de oferecer permanência e escolha aos usuários.

Este episódio serve como um alerta para a indústria de IA. O desenvolvimento de modelos cada vez mais avançados não pode ignorar a dimensão humana e emocional da interação. O futuro dos companheiros virtuais e da IA em geral dependerá não apenas da capacidade tecnológica, mas também da construção de diretrizes éticas robustas, da priorização da estabilidade e da criação de mecanismos que respeitem a profunda conexão que os usuários podem formar com essas entidades digitais. A era da IA não é apenas sobre algoritmos mais inteligentes, mas sobre como gerimos as emoções que eles inadvertidamente despertam.

Leia Também